Rentabilidad Bancaria en 2025: ¿Gestión Estratégica o Inercia de Balance?

La gestión de activos y pasivos (ALM) es la verdadera frontera de la rentabilidad sostenible.

La gestión de activos y pasivos (ALM) es la verdadera frontera de la rentabilidad sostenible.Veo a muchos CEOs y CFOs de bancos celebrando resultados extraordinarios al cierre del 2025. Con un BCP alcanzando un ROE del 26% y otros líderes sectoriales rondando el 17%, surge una pregunta fundamental para quienes gestionamos riesgos: ¿Es esta utilidad el resultado de una gestión brillante o simplemente el efecto de una asimetría estructural en el balance?

La respuesta técnica no es magia financiera, sino una combinación de gestión de brechas de tasas y la dinámica entre el Margen Financiero Neto (NII) y el Valor Económico del Patrimonio (EVE) en un entorno de tasas a la baja.

1. El Juego de la Repreciación: Por qué el NII “vuela” hoy

Para entender la rentabilidad actual, debemos mirar la velocidad con la que activos y pasivos cambian su tasa de interés. En el contexto actual, observamos un fenómeno de asimetría en la repreciación:

- El Pasivo (Fondeo): Muchos bancos tienen una estructura de fondeo de corto plazo o indexada que se reprecia rápidamente. Esto incluye el fondeo Overnight, cuentas corrientes remuneradas del Estado y fondeo institucional de corto plazo (AFPs y Seguros). Al bajar la tasa de referencia, el costo de captación cae casi de inmediato.

- El Activo (Colocaciones): El stock de préstamos “antiguos” está anclado a las tasas altas de periodos anteriores. El banco paga menos hoy por captar, pero sigue cobrando lo mismo por lo que prestó ayer.

Conceptualmente, el NII (Net Interest Income) se define como:

$$NII = \sum (Activos \times i_a) - \sum (Pasivos \times i_p)$$Donde $i_a$ e $i_p$ son las tasas de interés de activos y pasivos respectivamente. El riesgo (ΔNII) ocurre cuando el cambio en estas tasas no es simétrico en el tiempo.

2. NII vs. EVE: El Dilema del Risk Manager

Desde la perspectiva de Riesgo de Tasa de Interés en el Libro Bancario (IRRBB), tenemos dos métricas que cuentan historias distintas:

- ΔNII (Sensibilidad del Margen): Enfocado en el corto plazo (12 meses). Refleja el riesgo de que las utilidades que vemos en los titulares de prensa se muevan bruscamente ante cambios en la curva. Hoy luce robusto, pero es volátil.

- ΔEVE (Economic Value of Equity): Enfocado en el largo plazo. Es una métrica de valor que mide el impacto de los movimientos de tasa en el valor presente del patrimonio:

Si bien hoy el PnL luce robusto, la gestión de brechas debe ser activa (¡toc, toc Tesorería!). De lo contrario, el margen se estrechará inevitablemente conforme el stock de activos antiguos venza y sea reemplazado por préstamos a tasas nuevas y más bajas.

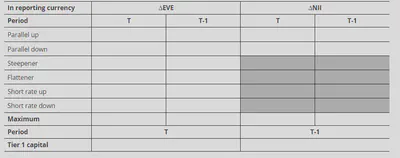

3. El Estándar de Basilea: El “Stress Test” del Balance

Para elevar el análisis, debemos remitirnos al estándar de divulgación IRRBB1 de Basilea. Como se observa en la siguiente tabla de requerimientos de reporte, la gestión de riesgos no se basa en promedios, sino en el peor resultado posible (Maximum) ante diversos escenarios de estrés.

Bajo este estándar, las entidades deben reportar el impacto en ΔEVE y ΔNII ante 6 escenarios de choque:

- Parallel up/down: Movimientos uniformes de la curva.

- Steepener / Flattener: Cambios en la pendiente (tasas largas vs. cortas).

- Short rate up/down: Choques específicos en el tramo corto, donde reside gran parte del fondeo institucional volátil.

La métrica de Maximum es la que realmente define la resiliencia. Si el impacto máximo en el EVE supera el 15% del capital Tier 1, la rentabilidad actual es solo una cortina de humo frente a un riesgo de balance mal gestionado.

Conclusión: ¿Estrategia o Falta de Calce?

En realidad, en muchos casos, la rentabilidad récord es por falta de gestión del balance. Así como hoy los márgenes se expanden, los P&L de muchos bancos se apretaron severamente cuando las tasas subieron por esa misma falta de calce.

Es innegable que calzar el balance es difícil si el fondeo estable y barato (cuentas sueldos y cuentas corrientes operativas) está concentrado en pocos bancos. Sin embargo, la verdadera salud financiera se mide en la capacidad de inmunizar el patrimonio ante cualquier movimiento de la curva, no en aprovechar un viento a favor temporal.

¿Está tu entidad gestionando activamente su EVE o solo disfrutando la inercia del NII? Me encantaría conocer tu perspectiva.

Análisis basado en los estándares de supervisión bancaria del BCBS (Basilea).